Einleitung: Verlagerung des Schwerpunkts von der Prävention zur Wiederherstellung In den letzten 20 Jahren lag der Hauptgrund für Investitionen in Cybersicherheit überwiegend auf der Prävention: Firewalls, Endgeräteschutz, Bedrohungsinformationen und das Ziel, Angreifer um jeden Preis fernzuhalten. Dieses Konzept war sinnvoll, als Vorfälle noch seltener auftraten und leichter eingedämmt werden konnten. Dieser Ansatz ist in einer…

Einführung: Warum sind Backups für Cassandra so wichtig? Cassandra ist dafür ausgelegt, niemals auszufallen. Cassandra-Backups sind wichtig, denn ohne ein ordnungsgemäßes Backup besteht die Gefahr, dass wichtige Daten verloren gehen. Die Replikation ist zwar eine wichtige Komponente, die vor Hardwareausfällen schützt, aber sie schützt nicht vor Datenverlust. Daher ist eine wiederherstellbare Sicherungskopie und die Aufbewahrung…

Wie sieht die aktuelle Landschaft bei Mainframe-Backup und Disaster Recovery aus? In einer IT-Umgebung – insbesondere in der Unternehmens-IT – bleibt die Mainframe-Sicherung eine der kritischsten und oft unterschätzten Disziplinen. Finanztransaktionen, Versicherungsdaten und staatliche Programme sind zunehmend auf Mainframes angewiesen, was bedeutet, dass auch die Risiken von Systemausfällen so hoch sind wie nie zuvor. Eine…

In den letzten Jahren haben Unternehmen insgesamt über 200 Milliarden Dollar in GPU-Infrastrukturen und Basismodelle für verschiedene KI-Anwendungen investiert. Doch die Datenschutzmaßnahmen, die all diesen Investitionen zugrunde liegen, stützen sich nach wie vor auf eine veraltete Infrastruktur, die nicht für KI-Workloads konzipiert wurde. Die Lücke zwischen dem, was Unternehmen aufbauen, und dem, was sie schützen…

Einführung: Warum sind Backups für MongoDB so wichtig? Wenn Sie MongoDB in der Produktion einsetzen, sind Backups unverzichtbar – sie können den Unterschied zwischen einer Wiederherstellung nach einem Vorfall und einem dauerhaften Datenverlust bedeuten. Eine Datenbank wie MongoDB, die Benutzerdaten, Transaktionen, Produktinformationen oder den Status von Anwendungen enthält, ist eine Datenbank, bei der die Datenintegrität…

Warum ist Ransomware eine kritische Bedrohung für die moderne Cybersicherheit? Ransomware-Angriffe verursachen seit mehr als einem Jahrzehnt erhebliche Störungen in zahlreichen Unternehmen. Sie führen zum Verlust wichtiger und sensibler Daten und haben weitere bedauerliche Folgen, wie z.B. die Zahlung hoher Geldbeträge an kriminelle Organisationen. Nahezu alle wichtigen Branchen sind regelmäßig auf die eine oder andere…

Was ist Sicherheit im High Performance Computing und warum ist sie wichtig? High Performance Computing (HPC) ist eine wichtige Infrastruktur für wissenschaftliche Entdeckungen, den Fortschritt bei der künstlichen Intelligenz und die nationale wirtschaftliche Wettbewerbsfähigkeit. Da diese Systeme immer sensiblere Forschungsdaten verarbeiten und geschäftskritische Rechenlasten unterstützen, reichen herkömmliche Sicherheitsansätze für Unternehmen nicht aus, um die einzigartigen…

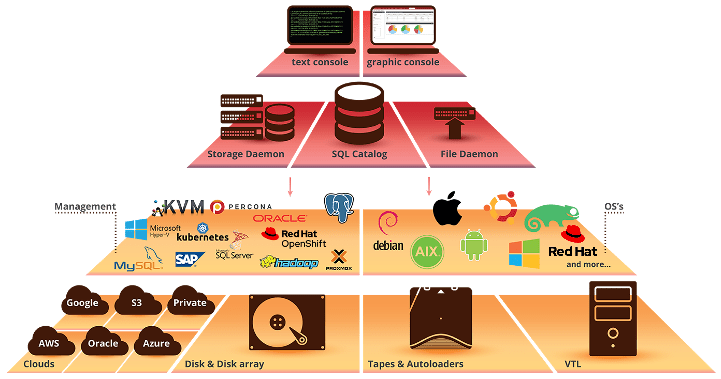

Einführung Die Sicherung von Unternehmensdaten ist eine umfassende Kombination aus Verfahren, Richtlinien und Technologien, die dazu dienen, geschäftskritische Informationen in großen und komplexen Unternehmensinfrastrukturen zu erhalten und zu schützen. Eine Unternehmenslösung zur Datensicherung besteht aus der Sicherungssoftware selbst, sowie aus Netzwerkverbindungen mit hoher Bandbreite, unveränderlichen Speichern verschiedener Art, internen Wissensdatenbanken, Schulungsprogrammen für Mitarbeiter und einer…

Was ist eine Solaris-Sicherung und warum ist sie wichtig? Bei der Solaris-Sicherung handelt es sich um die Erstellung von Kopien von Informationen, Systemkonfigurationen und Anwendungszuständen in der Solaris-Betriebssystemumgebung von Oracle. Backups sind entscheidend für die Sicherung von Informationen gegen Datenverlust, Systemausfälle und Sicherheitsverletzungen. Außerdem tragen Sicherungen positiv zur Business Continuity von Unternehmen bei, die mit…

Was ist OpenStack und wie funktioniert es? Die OpenStack Cloud-Plattform verstehen OpenStack ist eine Open-Source-Cloud-Computing-Plattform, die die Art und Weise, wie Unternehmen Rechenzentrumsinfrastrukturen einsetzen und verwalten, grundlegend verändern kann. Anstatt sich auf integrierte proprietäre Lösungen zu verlassen, verwendet OpenStack eine modulare Architektur, in der spezialisierte Komponenten(Module oder Services) verschiedene Infrastrukturfunktionen übernehmen. Im Kern ist OpenStack…

Was ist GPFS und warum ist Datensicherung wichtig? Die moderne Unternehmenslandschaft wird mit der Zeit immer datenorientierter, was eine zugrunde liegende Struktur erfordert, die große Datenmengen über verteilte Systeme hinweg verwalten kann und die meisten herkömmlichen Dateisysteme vor einzigartige Herausforderungen stellt. In diesem Zusammenhang möchten wir IBM Spectrum Scale, eine Lösung, die zuvor als General…

Was ist Lustre FS und warum ist die Datensicherung so wichtig? Das Lustre-Dateisystem ist ein wichtiger Bestandteil von Hochleistungsrechnerumgebungen, die für ihre parallelen Verarbeitungsaufgaben mit riesigen Datenmengen außergewöhnliche Speicherkapazitäten benötigen. Obwohl es ursprünglich für Supercomputing-Anwendungen entwickelt wurde, hat sich Lustre zu einer wertvollen Komponente von Infrastrukturen in Unternehmen entwickelt, die Datenoperationen im Petabyte-Bereich verarbeiten. Bevor…